14 Minuten

Die Nachricht, dass ein verrückter Wissenschaftler oder ein skrupelloses IT-Unternehmen ein weiteres Gerät gebaut hat, das Musik erzeugen kann, ist in diesen Tagen wie eine kaputte Schallplatte. Ehrlich gesagt, gibt es hier nichts Außergewöhnliches. Die Wahrheit ist, dass die KI seit den 1950er-Jahren Musik macht. Siebzig Jahre später haben die Roboter von Frankenstein die Musiker*innen nicht ersetzt. Wir sind immer noch da. Möglicherweise sogar mehr denn je.

Dennoch habe ich eine Ahnung, dass die Musiktechnologie innerhalb des nächsten Jahrzehnts vor einem großen Sprung steht. Aber nicht im Alleingang durch KI. Vielmehr denke ich an neuartige Computerhardware, insbesondere an Quantencomputer.

Quantencomputer sind so etwas wie eine überladene Version von Digitalcomputern. Letztere verarbeiten Informationen, die in Form von Bits kodiert sind, die wie winzige elektronische Schalter sind, die entweder 0 oder 1 sein können. Digitalcomputer verarbeiten Daten auf lineare, schrittweise Weise. Im Gegensatz dazu verwenden Quantencomputer Quantenbits oder Qubits. Diese Qubits können dank eines quantenmechanischen Phänomens namens Superposition gleichzeitig 0 und 1 verarbeiten. So können Quantencomputer viele Möglichkeiten gleichzeitig erkunden. Dadurch können sie eine große Menge an Informationen verarbeiten und komplexe Berechnungen schneller durchführen als digitale Computer.

Einfacher ausgedrückt: Ein klassischer Digitalcomputer funktioniert wie jemand, der ein Labyrinth Schritt für Schritt löst. Im Gegensatz dazu kann ein Quantencomputer alle möglichen Wege auf einmal erkunden und viel schneller einen Ausweg finden. Aber Geschwindigkeit ist nicht der einzige potenzielle Vorteil. Der Betrieb eines Quantencomputers erfordert eine andere Art des Denkens über die Codierung und Verarbeitung von Informationen. Und genau hier könnten Komponist*innen einen großen Vorteil haben. Diese neue Technologie wird es uns zwangsläufig ermöglichen, neue Wege zur Schaffung neuer Musik, neuer Stile und neuer Darstellungsformen zu entwickeln.

Das Kleingedruckte besagt, dass sich Quantencomputer noch in der Entwicklung befinden. Eine Handvoll Maschinen wurde bereits gebaut, und einige Unternehmen bieten bereits Zugang zu rudimentärer Quantenhardware in der Cloud für die Forschung. Aber sie sind nicht allgemein verfügbar. Und in der Tat sind sie teuer. Sehr teuer. Wir sprechen hier von mehreren Millionen Euro. Zum Vergleich: Ein anständiger Personal Computer kostet heute nur ein paar hundert Euro.

Es wird oft gesagt, dass der Entwicklungsstand von Quantencomputern heute mit dem Entwicklungsstand der großen Computer-Großrechner der 1950er-Jahre vergleichbar ist. Aber die Industrie macht enorme Fortschritte, und es zeichnen sich einige Möglichkeiten ab, Musiker*innen den Zugang zu dieser Technologie zu ermöglichen. Bereits jetzt nehmen Komponist*innen an Kursen zur Programmierung von Quantencomputern teil und verbringen Aufenthalte in Forschungslabors, um diese neue Technologie zu erforschen. So bietet das Yale Quantum Institute in den USA seit 2017 ein Artist-in-Residence-Programm an. Jedes Jahr nimmt das Institut bildende Künstler*innen oder Musiker*innen für einen einjährigen Aufenthalt auf, um ein auf Quantenwissenschaften basierendes Werk zu schaffen. Und das Goethe-Institut in Deutschland hat kürzlich ein internationales Artist-in-Residence-Programm namens Studio Quantum ins Leben gerufen.

Es sieht so aus, als würde sich die Geschichte wiederholen. Schon in den 1950er-Jahren, als Computer noch schwer zu bedienen, teuer und nicht weit verbreitet waren, begannen Komponist*innen in Forschungslabors zu experimentieren. In den letzten 70 Jahren sind die Fortschritte in der Computertechnologie und der Musikindustrie Hand in Hand gegangen. Computer haben eine entscheidende Rolle bei der Entwicklung der heutigen aufblühenden Musikindustrie gespielt. Eine wichtige Rolle bei diesen Entwicklungen spielten Komponist*innen, die das Potenzial der Computertechnologie für ihr Metier erkunden wollten.

So installierte der australische Rat für wissenschaftliche und industrielle Forschung (CSIR) in den frühen 1950er-Jahren einen Lautsprecher an seinem Mk1-Computer, um den Fortschritt eines Programms mit Hilfe von Ton zu verfolgen. In der Folge programmierte Geoff Hill, ein Mathematiker mit musikalischem Hintergrund, diese Maschine so, dass sie Volkslieder abspielte.

Der erste bedeutende Meilenstein der Computermusik wurde jedoch 1957 an der University of Illinois in Urbana-Champaign, USA, mit der Komposition der ILLIAC Suite von Lejaren Hiller und Leonard Isaacson gesetzt. Hiller, der damals Chemieprofessor war, arbeitete mit dem Mathematiker Isaacson zusammen, um die ILLIAC-Maschine so zu programmieren, dass sie ein Streichquartett komponierte.

Der ILLIAC, kurz für Illinois Automatic Computer, war einer der ersten in den USA gebauten Großrechner, der aus Tausenden von Vakuumröhren bestand. Sie programmierten diese Maschine mit Regeln für Harmonie und Kontrapunkt. Die Ausgabe wurde manuell in eine Partitur für ein Streichquartett übertragen. Während Mk1 lediglich eine kodierte Melodie abspielte – wie ein Pianola – wurde ILLIAC mit Algorithmen programmiert, um Musik zu komponieren. Daher wird die Illiac Suite oft als ein Pionierwerk der computergenerierten Musik bezeichnet.

Seitdem hat es verschiedene Entwicklungen gegeben, vor allem die Erfindung des Transistors und später des Mikrochips. Der Mikrochip ermöglichte die Herstellung von Computern, die nach und nach für breitere Bevölkerungsschichten zugänglich wurden.

Ein weiterer bedeutender Meilenstein fand Anfang der 1980er-Jahre am IRCAM mit der Komposition von Répons statt. Dabei handelt es sich um eine noch nie dagewesene Komposition des berühmten französischen Dirigenten Pierre Boulez. Das IRCAM (kurz für Institut de Recherche et Coordination Acoustique/Musique) ist ein Forschungszentrum für Musik und Technologie, das 1977 von Boulez selbst in Frankreich gegründet wurde.

Répons, ein Werk für Kammerorchester und sechs Solo-Schlagzeuger, war das erste bedeutende klassische Musikstück, bei dem digitale Rechentechnik für die Live-Aufführung auf der Bühne eingesetzt wurde. Die Maschine "hörte" den Solisten zu und reagierte mit synthetischen Klängen auf der Stelle während der Aufführung. Zu diesem Zweck verwendete Boulez das vom Physiker Giuseppe Di Giugno und seinem Team am IRCAM entwickelte 4X-System.

Wenn Sie mich fragen, verkörpert Répons den Beginn einer Ära, in der digitale Computer in immer größerem Umfang zur Entwicklung neuer Kompositions- und Aufführungsansätze eingesetzt werden. Es steht für den Beginn unserer heutigen Zeit, in der Personal Computer, Laptops, Notebooks, Tablets und sogar Smartphones in der Musikkomposition und -aufführung eingesetzt werden.

Die Quanteninformatik ist seit der Jahrtausendwende auf meinem Radar. Am Anfang war alles theoretisch, seltsam und schwer zu begreifen. Zu dieser Zeit wurden noch keine Quantencomputer gebaut. Erst 2017 erfuhr ich, dass Rigetti Computing, damals ein Start-up-Unternehmen mit Sitz in Berkeley, Kalifornien, bekannt gab, dass sie einen Quantencomputer gebaut hatten und Beta-Tester suchten, um ihn auszuprobieren. Kurzerhand packte ich meinen Koffer und machte mich auf den Weg nach Berkeley, um das Ganze mit eigenen Augen zu sehen. Der Rest ist Geschichte.

Ich habe Zeno, meine erste vollwertige Komposition mit Quantencomputern, 2018 fertiggestellt. Zeno ist ein Erkundungsstück für Bassklarinette und elektronische Klänge. Während der Aufführung hörte sich ein lokaler Laptop die auf der Klarinette gespielten Melodien an und extrahierte Kompositionsregeln. Diese Regeln wurden in Quantenalgorithmen umgewandelt und über das Internet an den Quantencomputer in Kalifornien übertragen. Der Quantencomputer führte die Algorithmen aus und übermittelte die Ergebnisse an meinen Laptop, der sie in synthetische musikalische Antworten umsetzte. Der Quantencomputer fungierte als Mitmusiker*innen, der zu den Klarinettenmelodien improvisierte, wie bei einem Jazzkonzert. Video 1 zeigt eine Aufnahme von Zeno, die an der Universität von Plymouth, UK, mit Sarah Watt an der Bassklarinette gemacht wurde. Omar Costa Hamido und ich bedienten die elektronischen Klänge bzw. die Rigetti-Maschine in der Cloud.

Zeno ist für mich ein Meilenstein. Was ich mit einem rudimentären Quantencomputer mit nur wenigen Qubits erreicht habe, würde für eine hochmoderne digitale Desktop-Maschine eine anspruchsvolle KI-Programmierung erfordern. Das hat mich in meiner Vermutung bestärkt, dass die Musiktechnologie kurz vor einem großen Sprung steht. Der Gedanke daran, was ein vollwertiger Quantencomputer Musiker*innen in 20 oder sogar 10 Jahren ermöglichen könnte, ist verblüffend.

Aber was ist Quantencomputing? Wie kann ein Quantenalgorithmus musikalische Regeln darstellen? Wie können die Ergebnisse der Verarbeitung eines Quantenalgorithmus Musik machen? Lassen Sie uns zunächst genauer untersuchen, was einen Quantencomputer von einem digitalen Computer unterscheidet.

Ich habe bereits erwähnt, dass ein Quantencomputer mit Informationen arbeitet, die als Quantenbits oder Qubits kodiert sind. Das Qubit ist für einen Quantencomputer das, was ein Bit für einen digitalen Computer ist: Es ist eine grundlegende Informationseinheit. In der Hardware leben die Qubits in der subatomaren Welt. Sie sind den Gesetzen der Quantenmechanik unterworfen. Dadurch verarbeiten Qubits Informationen grundlegend anders als digitale Bits.

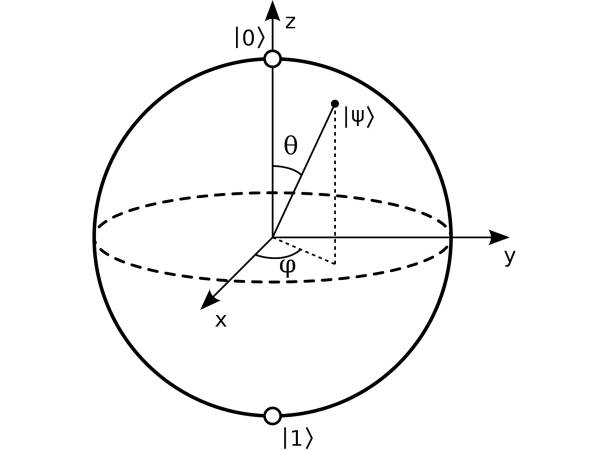

Um sich ein Qubit vorzustellen, muss man sich eine transparente Kugel mit entgegengesetzten Polen vorstellen, die mit |0⟩ und |1⟩ bezeichnet werden, was der Konvention zur Darstellung von Quantenzuständen entspricht. Von ihrem Zentrum aus kann ein Vektor, dessen Länge gleich dem Radius der Kugel ist, auf eine beliebige Stelle der Oberfläche zeigen. In der Quantenmechanik wird diese Kugel als Bloch-Kugel bezeichnet, und der Vektor wird als Zustandsvektor bezeichnet. Der Zustandsvektor eines Qubits stellt einen Quantenzustand dar und kann in Form von Polarkoordinaten mit zwei Winkeln, θ und φ, beschrieben werden, wie in Abbildung 1 dargestellt.

Abbildung 1: Die Bloch-Kugel ist eine geometrische Darstellung eines Qubits.

Ein Zustandsvektor kann überall zwischen den Nord- und Südpolen der Bloch-Kugel liegen. Wenn er dies tut, befindet sich das Qubit in einem Überlagerungszustand zwischen |0⟩ und |1⟩. Kurz gesagt, das Qubit kann beides gleichzeitig darstellen. Aber das Qubit wird immer den Wert 0 oder 1 haben, wenn wir es auslesen.

Im Zustand der Überlagerung wird der Zustandsvektor normalerweise als Linearkombination von |0⟩ und |1⟩ beschrieben. Zum Beispiel wird der Zustandsvektor |Ψ⟩ notiert als |Ψ⟩= α|0⟩+ β|1⟩, wobei die Koeffizienten α und β die Tendenzen nach Norden bzw. Süden darstellen. Einfacher ausgedrückt: Die Position des Vektors auf der Bloch-Kugel gibt an, ob das Qubit beim Auslesen eher den Wert 0 (wenn es auf eine Region oberhalb der Äquatorlinie zeigt) oder den Wert 1 (wenn es unterhalb der Äquatorlinie zeigt) annimmt. In der Terminologie der Quanteninformatik werden α und β als Amplituden bezeichnet und der Akt des Auslesens eines Qubits wird als "Messen" bezeichnet.

Das Merkwürdigste an der ganzen Sache ist, dass Quantencomputer Informationen mit Qubits in Überlagerung verarbeiten. Ein großer Teil der Kunst der Programmierung eines Quantencomputers besteht darin, Qubits in einem solchen unbestimmten Zustand zu manipulieren.

Quantencomputer werden durch die Anwendung von Operationsfolgen auf Qubits programmiert. In der Terminologie des Quantencomputers werden die Qubit-Operationen als Gatter bezeichnet. Programmierwerkzeuge für Quantencomputer bieten mehrere Gatter Das RX(𝜋)-Gatter dreht den Zustandsvektor eines Qubits um 180 Grad um die x-Achse der Bloch-Kugel-Geometrie. Wenn also der Qubit-Vektor nach |0⟩ zeigt, wird er durch dieses Gatter nach |1⟩ gedreht und umgekehrt.

Das RX(𝜋)-Gatter wird oft als NOT-Gatter bezeichnet und mit X notiert. Ein Programm wird oft als eine Schaltung mit Quantengattern dargestellt, die auf Qubits wirken. Daher wird ein Programm in der Quantencomputer-Terminologie als Quantenschaltung bezeichnet.

Die Durchführung von Operationen an Gruppen von Qubits in Überlagerung ermöglicht die gleichzeitige Manipulation vieler möglicher Konfigurationen von Informationen. Zum Vergleich: Ein digitaler Prozessor verarbeitet Informationen, die durch eine Reihe von Bits dargestellt werden, die einzeln ein- und ausgeschaltet werden. Mit 3 Bits kann ein System zum Beispiel die Zahlen 0 bis 7 wie folgt darstellen: 000, 001, 010, 011, 100, 101, 110 bzw. 111. Ein digitaler Prozessor verarbeitet diese Daten nacheinander. Mit 3 Qubits hingegen stellt ein Quantenprozessor diese Zahlen gleichzeitig dar, um sie parallel zu verarbeiten.

Mit 20 Qubits könnte ein System gleichzeitig über eine Million Informationen verarbeiten, die als Quantenzustände in Überlagerung dargestellt werden. Derzeit verfügen einige Quantencomputer bereits über Hunderte von Qubits. Das ist noch keine große Sache. Es wird aber erwartet, dass sie bald Tausende oder Millionen von Qubits haben werden. Bevor diese Maschinen große Mengen von Qubits für Berechnungen nutzen können, sind noch einige Probleme zu lösen. Aber das ist keine Frage des Ob, sondern des Wann.

Die Wunder der Quantenberechnung sind hier noch nicht zu Ende. Zusätzlich zur Überlagerung beinhaltet die Quantenprogrammierung die Verschränkung von Gruppen von Qubits. Verschränkte Qubits interagieren – oder interferieren – miteinander und werden nicht mehr einzeln betrachtet. Sie bilden ein eigenes Quantensystem. Um dies zu verdeutlichen, sollten wir uns überlegen, wie sich der abstrakte Begriff der Qubits auf die physische Welt bezieht.

Nehmen wir den Fall eines Elektrons. In der Quantenmechanik ist der physikalische Zustand eines Elektrons unbekannt, bis man es beobachtet. Bevor es beobachtet wird, verhält sich das Elektron wie eine Welle. Wenn es beobachtet wird, wird es zu einem Teilchen. Dieses Phänomen wird als Welle-Teilchen-Dualismus bezeichnet. Qubits sind exquisit, weil sie diesen Dualismus verkörpern.

Quantensysteme können mit Hilfe von Wellenfunktionen beschrieben werden. Eine Wellenfunktion stellt ein Quantensystem als die Summe der möglichen Zustände dar, in die es fallen kann, wenn es gemessen wird. Mit anderen Worten: Sie definiert, wie ein Teilchen aussehen könnte, wenn die Welle beobachtet wird.

Beim Quantencomputing gilt: Je mehr Qubits zur Konstruktion einer Wellenfunktion verwendet werden, desto größer ist die Zahl der möglichen Ergebnisse, die ein System hervorbringen kann. Jede mögliche Komponente einer Wellenfunktion ist auch eine Welle. Sie wird durch Amplitudenkoeffizienten skaliert, die ihre relative Gewichtung widerspiegeln. Einige Zustände sind wahrscheinlicher als andere. Stellen Sie sich ein Quantensystem metaphorisch als das Spektrum eines musikalischen Klangs vor, bei dem die unterschiedlichen Amplituden seiner verschiedenen Wellenkomponenten seine einzigartige Klangfarbe ergeben.

Wie bei den Schallwellen interferieren die Komponenten der Quantenwellen miteinander, konstruktiv und destruktiv. In der Quantenphysik werden die interferierenden Wellen in einer Wellenfunktion als kohärent bezeichnet. Durch die Beobachtung der Wellenfunktion werden die Wellen dekohärent. Wiederum metaphorisch gesprochen ist es so, als würde man beim Hören eines musikalischen Klangs nur eine einzige Spektralkomponente wahrnehmen; wahrscheinlich diejenige mit der höchsten Energie, aber das ist nicht immer so.

Überlagerung, Verschränkung und Interferenz sind grundlegende Eigenschaften der Quanteninformatik, wodurch sie sich grundlegend von der digitalen Datenverarbeitung unterscheidet. Ein wichtiges Merkmal von Quantencomputern ist, dass die Ergebnisse des Auslesens von Quantenzuständen nicht mit absoluter Sicherheit vorhergesagt werden können. Es gibt Methoden, um dies zu umgehen. Es ist jedoch nicht unüblich, die Unvorhersehbarkeit von Quantenzuständen für bestimmte Anwendungen, einschließlich Musik, zu nutzen. In der Tat haben sich viele Komponist*innen die Stochastik zu eigen gemacht, von Mozart im 18. Jahrhundert über Stockhausen im 20.

Lassen Sie uns nun eine Methode zum interaktiven Musizieren mit Quantencomputern genauer untersuchen. Ich habe sie ursprünglich für die oben erwähnte Komposition Zeno entwickelt. Seitdem habe ich sie aber weiterentwickelt und verfeinert. Die letzte Inkarnation wurde für die Komposition Qubism in die Praxis umgesetzt. Dies ist ein sonatenartiges Stück in drei Sätzen für eine Kammermusikgruppe, einen Quantencomputer und Elektronik, das für die London Sinfonietta komponiert wurde.

Das System extrahiert Sequenzierungsregeln aus der eingegebenen Musik und stellt sie in Form von Quantenschaltungen dar. Dann lässt es diese Quantenschaltungen laufen, um musikalische Antworten zu erzeugen (Abbildung 2). Sobald das System einige Regeln gelernt hat, kann es so viele neue Melodien von praktisch beliebiger Länge wie nötig erzeugen.

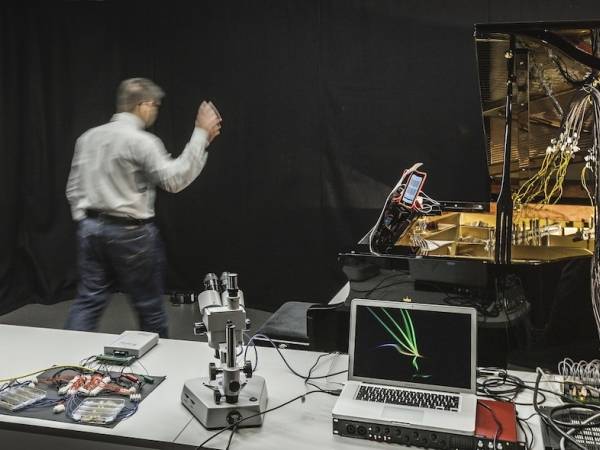

Abbildung 2: Das Quantensystem, das für Qubism entwickelt wurde, hört einer Geige zu und erzeugt Antworten während einer Aufführung.

Schauen wir uns an, wie die vom System extrahierten Regeln aussehen. Nehmen wir an, das System hat die folgenden Regeln aus einer hypothetischen Eingabemelodie extrahiert:

C3 => D3(25%) V G#3(25%) V C4(25%) V D4(25%)

D3 => C3(30%) V E3(70%)

E3 => D3(25%) V F#3(25%) V A#3(25%) V C4(5%) V D4(20%)

F#3 => E3(100%)

G#3 => C3(30%) V A#3(70%)

A#3 => E3(33%) V G#3(33%) V C4(34%)

C4 => C3(30%) V A#3(70%)

D4 => C3(20%) V E3(80%)

Die zweite Regel besagt beispielsweise, dass auf die Note 𝐷3 mit einer Wahrscheinlichkeit von 30 % die Note 𝐶3 und mit einer Wahrscheinlichkeit von 70 % die Note 𝐸3 folgen wird. Das Symbol "∨" steht für "oder", und die Prozentzahl in Klammern neben den Noten ist ihr Gewichtungskoeffizient, hier ausgedrückt in der Wahrscheinlichkeit des Auftretens. Wenn wir also dem System eine der oben genannten Anfangsnoten auf der linken Seite des Pfeils vorgeben, wird es die entsprechende Regel verarbeiten und eine neue Note erzeugen. Diese neue Note wird anschließend verwendet, um eine Regel auszuwählen, die eine weitere Note erzeugt, und so weiter.

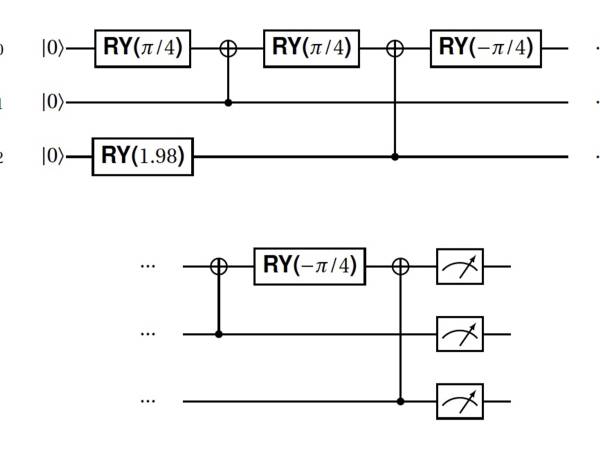

Die Quantenschaltung für die zweite Regel ist in Abbildung 3 dargestellt. Diese Schaltung setzt drei Qubits ein, um einen Quantenzustand zu erzeugen, der die Wahrscheinlichkeitsverteilung der Regel darstellt. Um dies zu ermöglichen, stellt das System jede einzelne Note mit einem Binärcode dar.

Je größer die Anzahl der verschiedenen Noten in der Eingabemusik ist, desto höher ist die Anzahl der Ziffern, die für ihre Codierung erforderlich sind. Im vorliegenden Beispiel hatte die hypothetische Eingabe acht Noten. Daher sind hier drei Ziffern ausreichend. Zum Beispiel 𝐶3 = 000, 𝐷3 = 001, 𝐸3 = 010, und so weiter.

In der binären Darstellung lässt sich die zweite Regel also wie folgt ausdrücken:

001 ⇒ 000(30%) ∨ 010(70%)

In diesem Fall programmiert die entsprechende Schaltung in Abbildung 3 die Qubits so, dass sie bei der Messung höchstwahrscheinlich entweder 000 oder 010 ergeben.

Abbildung 3: Schaltkreis für die Regel 100 ⇒ 000(30%) ∨ 101(70%).

Die Schaltung wird von links nach rechts gelesen. Die verschiedenen Gatter RY teilen dem System mit, wie die Qubits 𝑞0, 𝑞1 und 𝑞2 entlang der Meridianachse der Bloch-Kugel gedreht werden sollen. Bei der Messung (dargestellt durch die Kästchen mit der Skala am Ende) sollte die Schaltung im Idealfall entweder 000 mit einer Wahrscheinlichkeit von 30 % oder 101 mit einer Wahrscheinlichkeit von 70 % ausgeben. (Die Qubits werden in dieser Reihenfolge gelesen: 𝑞2𝑞1𝑞0.)

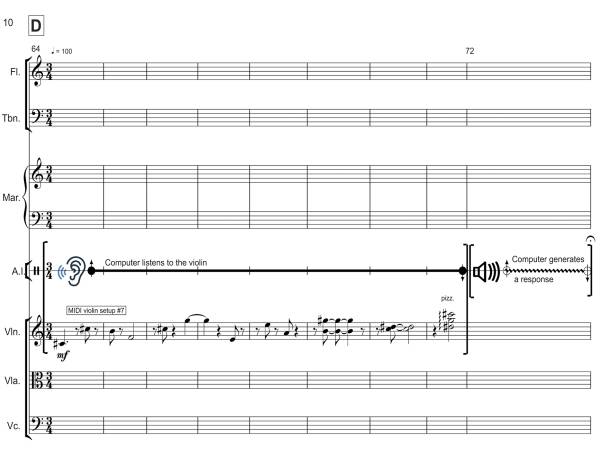

In der Partitur von Qubism gibt es Momente, die anzeigen, wann das System einem Instrument zuhört und eine Antwort erzeugt. Die aktuelle Version des Systems kann nur auf ein Instrument des Ensembles hören: die Violine.

Abbildung 4 zeigt einen Auszug aus der Partitur, der eine Passage illustriert, in der der Quantencomputer einer von der Geige gespielten Melodie lauscht und eine Antwort von etwa 20 Sekunden Dauer erzeugt.

Abbildung 4: Ein Auszug aus der Partitur für Qubismus.

Die Kammermusikgruppe besteht aus Flöte, Posaune, Marimba, Violine, Viola und Violoncello. Das System erzeugt Antworten mit einem synthetischen Saxophon und perkussiven Klängen. Das Stück enthält auch einen elektronisch erzeugten Track (in Abbildung 4 nicht dargestellt), den ich ebenfalls mit Quantencomputern komponiert habe, und zwar mit einer Methode namens Partitioned Quantum Cellular Automata (PQCA). Die PQCA-Methode wird in dem Buch Quantum Computer Music: Foundations, Methods and Advanced Concepts, das 2022 bei Springer erschienen ist.

Für die Uraufführung von Qubism durch die London Sinfonietta am King's Place, London, im Juni 2023 habe ich eine IBM Quantum-Maschine in der Cloud verwendet. Video 2 zeigt einen Ausschnitt aus der Premiere. Achten Sie auf den Abschnitt gegen Ende, wo der Geiger eine Solomelodie spielt und der Quantencomputer Antworten mit perkussiven Klängen erzeugt.

Das obige Beispiel ist nur ein kleiner Vorgeschmack darauf, wie das Quantencomputing für die Musik nutzbar gemacht werden kann. Es gibt eine wachsende Gemeinschaft von Musiker*innen und Quantencomputer-Entwicklern, die sich diese Technologie zu eigen machen. Sie entwickeln innovative Ansätze für das Musizieren. Einige davon wurden auf dem 2nd International Symposium on Quantum Computing for Musical Creativity vorgestellt, das im Oktober 2023 in Berlin stattfand. Quantencomputer stehen unmittelbar vor der Tür.

Die Integration von Quantencomputern in den Bereich der Musik stellt eine aufregende Herausforderung dar, die die Art und Weise, wie wir Musik schaffen, komponieren und erleben, zu revolutionieren verspricht. Von der Beschleunigung der musikalischen Innovation bis hin zur Erschließung neuer Wege der Kreativität – das Potenzial des Quantencomputing in der Musik ist grenzenlos. Wir wissen nicht mit Sicherheit, wie es sich auf die Musik auswirken wird. Aber das werden wir erst wissen, wenn wir es ausprobiert haben.

Die Konvergenz von Technologie und Kunst ist ungebrochen, und die Nutzung des transformativen Potenzials von Quantencomputing in der Musik verspricht, eine neue Ära für die Musikindustrie einzuläuten.

Eduardo R. Miranda

Eduardo Reck Miranda ist Komponist von elektronischer und zeitgenössischer Konzertmusik und entwickelt seit Anfang der 1990er Jahre KI für Musik. Er ist ein Pionier in der Komposition von Musik mit Quantencomputern und hat für renommierte Ensembles wie das BBC Concert Orchestra und die London Sinfonietta komponiert. Seine Oper Lampedusa wurde 2019 von den BBC Singers uraufgeführt. Miranda ist Professor an der University of Plymouth, UK, Leiter des Interdisciplinary Centre for Computer Music Research (ICCMR) der Universität und Forschungsdirektor bei Moth Quantum. Sein jüngstes Buch, Quantum Computer Music, wurde 2022 bei Springer veröffentlicht.

Artikelthemen

Artikelübersetzungen erfolgen maschinell und redigiert.

Eduardo R. Miranda

Eduardo R. Miranda